OpenAI 今天宣布,開始測試一款全新的 AI 模型 Sora,可以讓使用者利用文字指令,創造出動態影片,而且效果看起相當不錯。

Sora 模型:用 AI 做影片效果很好

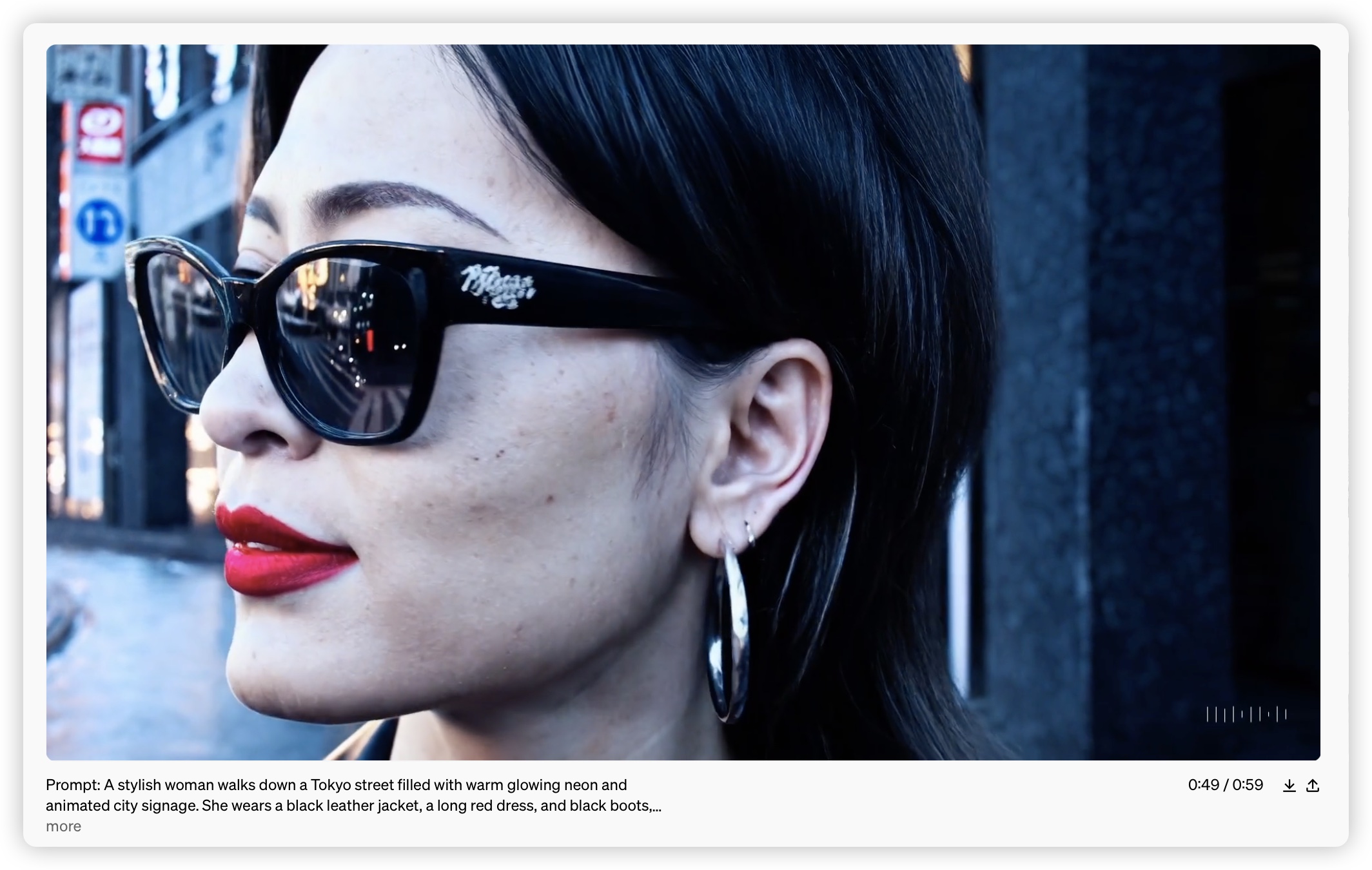

OpenAI 在 Sora 的介紹網頁中展示了好幾段影片,都是透過 Sora 所創造的,你可以看到後面文字的部分是亂碼,這就是 AI 生成的其中一個證明。

https://t.co/rmk9zI0oqO pic.twitter.com/WanFKOzdIw

— Sam Altman (@sama) February 15, 2024

而且生成的效果真的很好,除了文字的處理還不行以外,就連皮膚的細紋就可以很清楚的呈現。

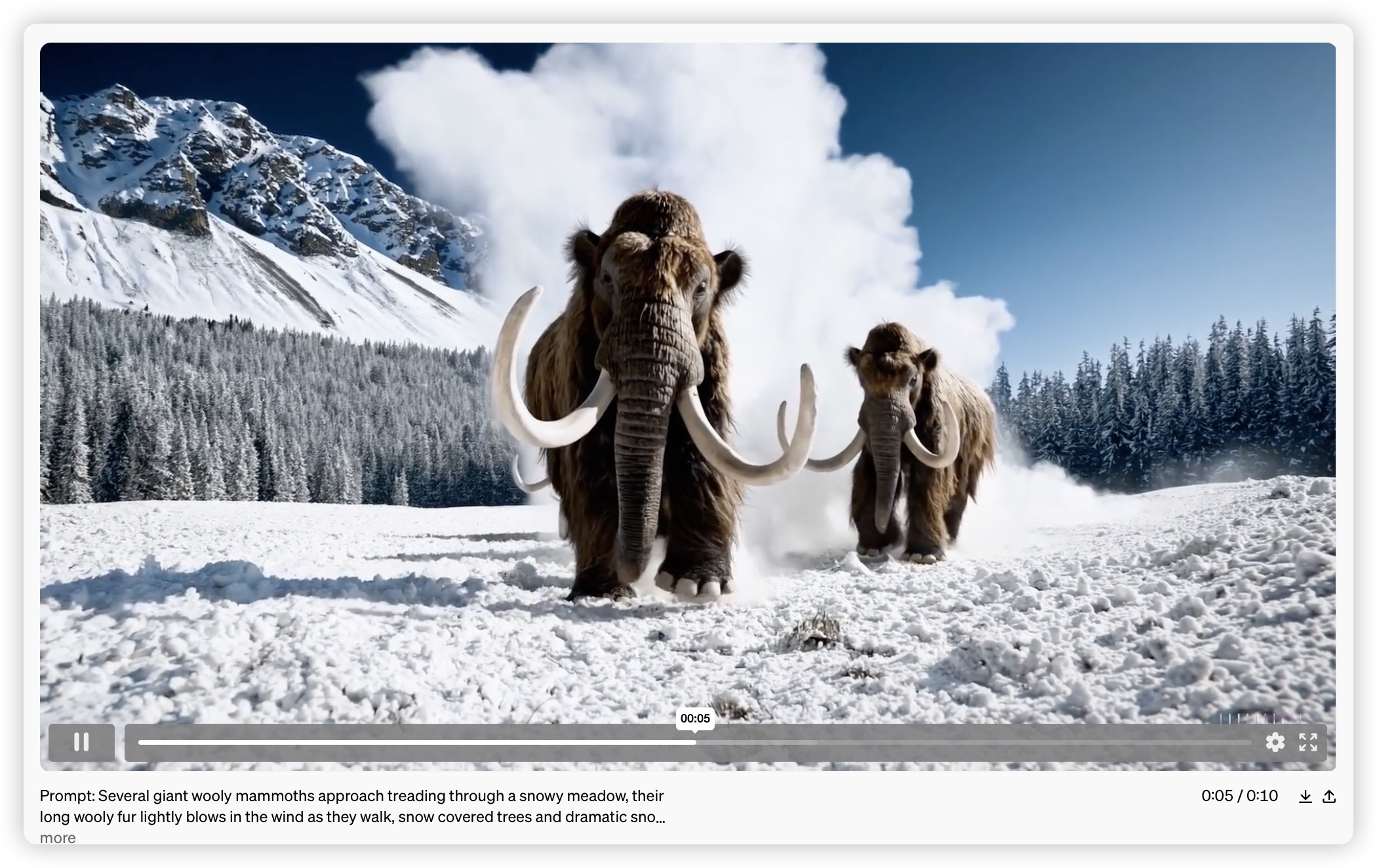

過去這種揚起的煙塵、粒子都需要在後製公司透過 3D 軟體進行模擬、運算,然後再透過 2D 做合成才會真實,現在直接一鍵搞定,還相當的真實。

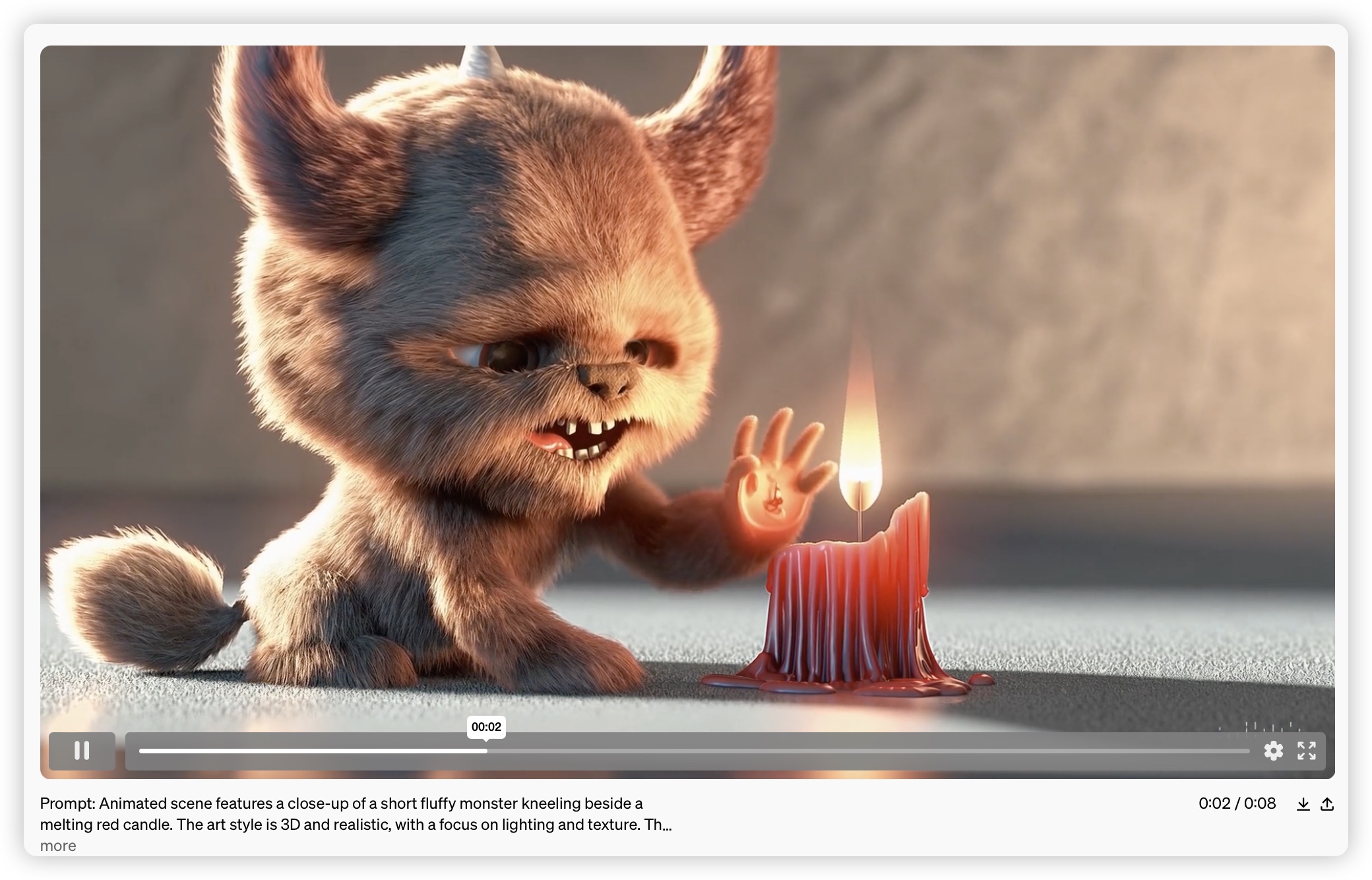

甚至可以做出不同的風格,除了寫實的風格以外,以後也可以直接用 AI 做卡通,搞不好以後皮克斯、尼士尼的電影會有一部分是搭配 AI 完成,甚至到更後面直接整片都用 AI 做完也不讓人驚訝了。

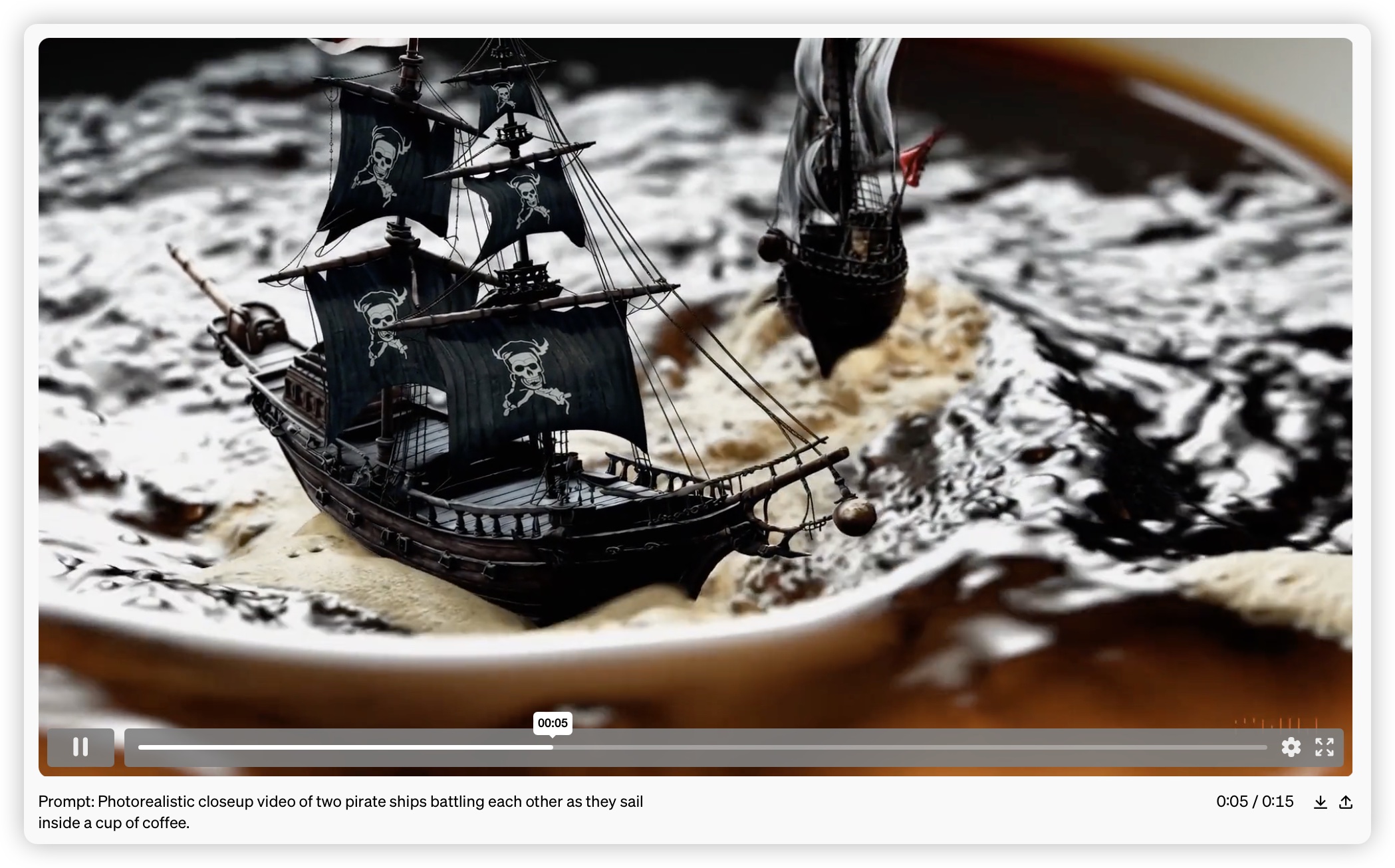

注意看這個影片下面的 Promopt 只有短短的兩行(或是你要說只有一行我都覺得沒錯),就可以做出這樣 15 秒的微距影片效果,這看起來就已經是一部廣告片的質感和長度了。

OpenAI 更釋出了一段影片,裡面有好幾個片段,這些片段全部都是利用 Sora 所生成的,OpenAI 還在每個片段下面附上了生成影片所使用的 Prompt 指令。

目前最長 1 分鐘,開放少數人測試

OpenAI 也說到,目前 Sora 的能力還太弱(但我覺得真的很不錯了),有些影片生成的結果還是會出現不合理或不自然的地方地方,而且視覺上常常會有不連貫的時候,所以還是要持續調整。

目前也只開放極少部分的創作者可以使用,每次生成的影片最長 1 分鐘,可以支援生成 1920×1080 或 1080×1920 的格式。

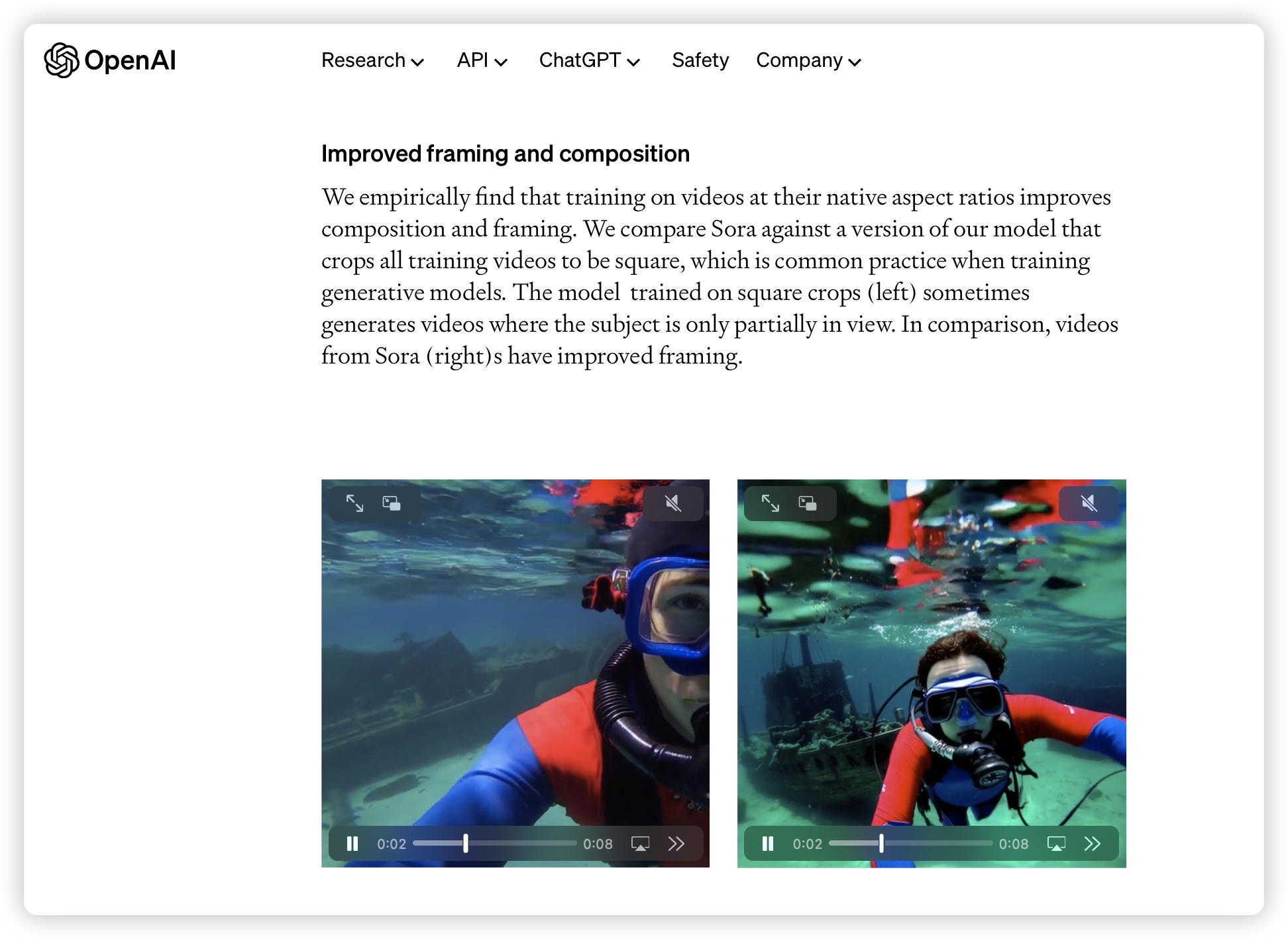

OpenAI 的網站上有一個頁面專門在介紹他們是如何利用 AI 生成 AI 影片,說明得蠻詳細,文字搭配圖片、影片很容易理解,大家如果有興趣了解的話可以看看。

是說前幾天才分享了 Apple 的研究人員才發表他們新的開源 AI 模型 MGIE,並且可以透過 MGIE 將文字轉成動態影像,結果今天 OpenAI 就宣佈 Sora 這個 AI 模型,而且老實說效果看起來比 Apple 研究人員發表的還要更好。